Com a popularização da IA generativa, especialistas alertam para riscos de desinformação, fenômeno que desafia a Justiça Eleitoral e expõe eleitores a novas formas de manipulação política

As eleições brasileiras entram em uma nova fase marcada pela presença crescente da inteligência artificial no debate público. Ferramentas capazes de gerar textos, imagens, vídeos e até vozes realistas já fazem parte do cotidiano da comunicação digital e, inevitavelmente, passam a ser utilizadas também na arena política.

O fenômeno preocupa especialistas. Conteúdos manipulados por inteligência artificial, conhecidos como deepfakes, podem simular falas, imagens ou comportamentos de candidatos e autoridades, criando situações falsas que parecem reais. Essa tecnologia utiliza redes neurais para alterar ou produzir imagens e áudios com elevado grau de realismo, o que dificulta a identificação da fraude por parte do público.

O avanço dessas ferramentas ocorre em um momento de intensa polarização política e de forte dependência das redes sociais para a formação da opinião pública. Em 2025, ataques envolvendo deepfakes cresceram 126% no Brasil, segundo levantamento do relatório “Identity Fraud Report 2025-2026”. A manipulação inclui vídeos, vozes e até documentos falsificados que circulam nas plataformas digitais.

Para a cientista da computação Nina da Hora, pesquisadora da área de inteligência artificial e justiça algorítmica, a tecnologia em si não é o problema, mas sim o uso que se faz dela. Segundo ela, manipulações digitais podem ser utilizadas deliberadamente para atingir reputações ou influenciar decisões coletivas.

Nina da Hora é pesquisadora em inteligência artificial e justiça algorítmica

“Não é apenas manipular uma imagem ou um vídeo. Muitas vezes existe a intenção de desmoralizar projetos políticos ou até desestabilizar processos democráticos”, afirma a pesquisadora.

Essa preocupação se intensificou após as eleições municipais de 2024, as primeiras no Brasil após a popularização das ferramentas de IA generativa. Levantamentos apontam que a Justiça Eleitoral julgou pelo menos 159 casos relacionados ao uso de inteligência artificial na propaganda política, incluindo vídeos falsos simulando reportagens de telejornais ou declarações inexistentes de candidatos.

O resultado é um novo cenário eleitoral em que a disputa política se estende para um território digital cada vez mais sofisticado, e difícil de monitorar.

DEEPFAKE, ROBÔS E CAMPANHAS DIGITAIS: COMO A TECNOLOGIA INFLUENCIA O ELEITOR

Se os deepfakes representam o aspecto mais visível da manipulação digital, outra ferramenta igualmente poderosa atua nos bastidores das redes sociais: os chamados robôs ou bots políticos.

Esses sistemas automatizados são programados para publicar mensagens, comentar em massa e compartilhar conteúdos com o objetivo de aumentar artificialmente a visibilidade de determinadas narrativas. Em ambientes como Twitter, Facebook ou Telegram, milhares de contas automatizadas podem agir simultaneamente para inflar a popularidade de um candidato ou atacar adversários.

O pesquisador Fabrício Benevenuto, professor da Universidade Federal de Minas Gerais (UFMG) e especialista em desinformação nas redes sociais, afirma que esses mecanismos exploram o comportamento coletivo dos usuários.

“Se muitas pessoas compartilham uma ideia, outras tendem a segui-la”, explica o pesquisador, destacando que o comportamento de manada nas redes pode influenciar a percepção pública sobre determinado tema ou candidato.

Segundo Benevenuto, robôs conseguem simular padrões de comportamento humano, o que dificulta sua identificação pelas plataformas digitais. Em experimentos conduzidos por pesquisadores, contas automatizadas permaneceram ativas durante semanas sem serem detectadas.

Esse tipo de manipulação vai além da teoria. Estudos acadêmicos que analisaram milhões de publicações nas redes sociais durante eleições brasileiras identificaram padrões de atuação de bots amplificando determinadas agendas políticas e distorcendo o debate público.

Ao mesmo tempo, campanhas digitais passaram a investir cada vez mais em microsegmentação de conteúdo, publicidade direcionada e produção massiva de mensagens para aplicativos como WhatsApp e Telegram, canais nos quais a fiscalização é mais difícil, além de comentários acusatórios e caluniosos no Instagram, Tiktok e outras redes sociais.

Para especialistas, essa combinação entre automação, inteligência artificial e propaganda política cria um ambiente onde a velocidade de circulação da desinformação muitas vezes supera a capacidade de resposta das instituições.

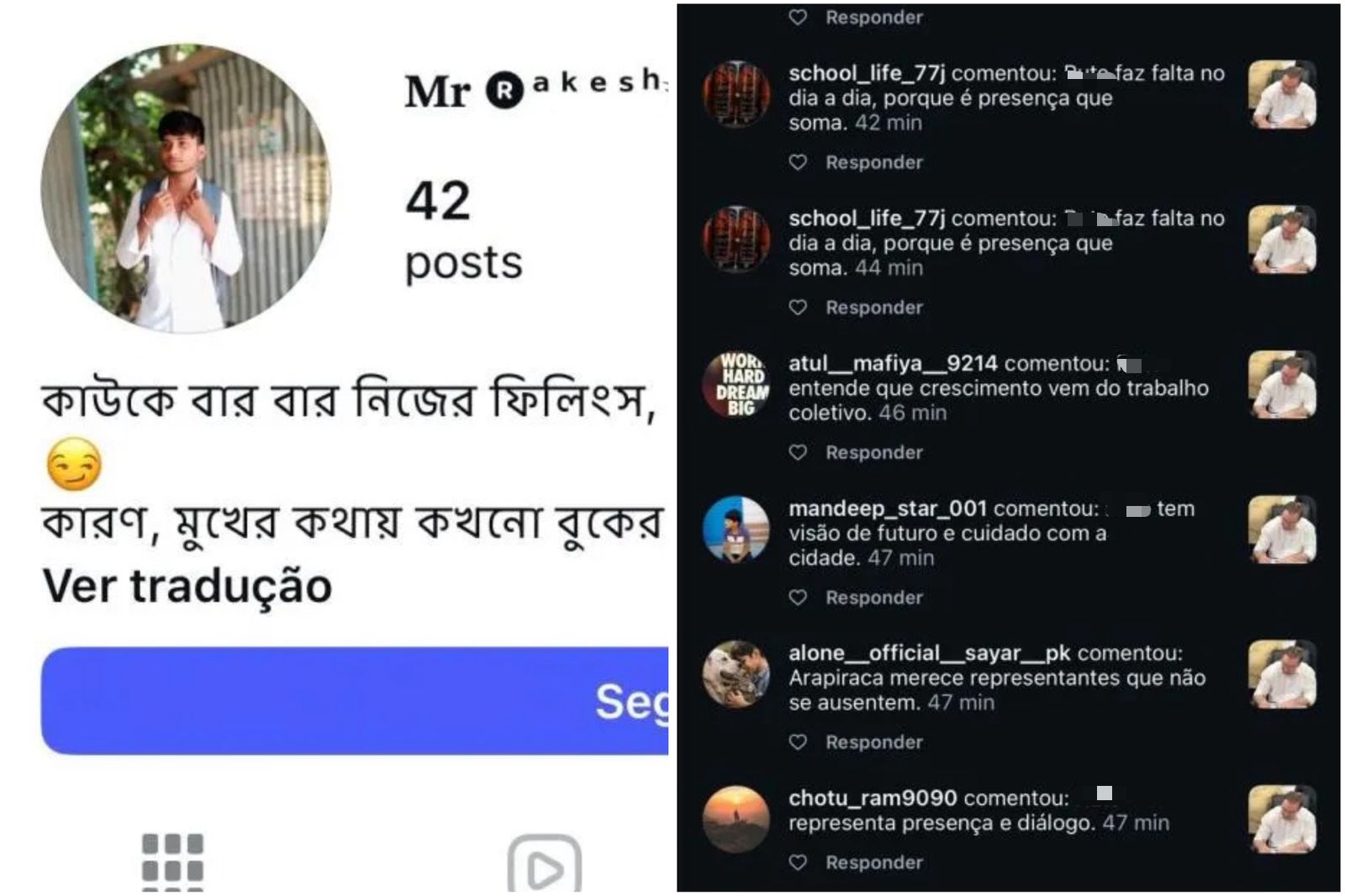

Em Alagoas, os perfis oficias da Prefeitura de Arapiraca e do deputado federal Daniel Barbosa foram alvo dos chamados bots de texto. Algumas postagens em suas redes sociais receberam enxurradas de comentários de perfis nitidamente fakes, de outros países. Algumas mensagens eram de acusações infundadas e reclamações genéricas e outras enalteciam o nome de uma pré-candidata local que faz parte de um grupo que rompeu politicamente com o prefeito da cidade, Luciano Barbosa, e com parlamentar. A ação colocou um "pin" de localização no gabinete do ódio local.

JUSTIÇA ELEITORAL TENTA ACOMPANHAR AVANÇO TECNOLÓGICO

-

Diante do crescimento da manipulação digital, a Justiça Eleitoral brasileira começou a atualizar as regras para o uso de tecnologia nas campanhas.

Em 2024, o Tribunal Superior Eleitoral (TSE) aprovou uma resolução que proíbe expressamente o uso de deepfakes em propaganda eleitoral. A norma define esse tipo de conteúdo como material manipulado digitalmente para alterar a imagem ou a voz de uma pessoa com objetivo de enganar o público.

A regulamentação também exige que campanhas que utilizem inteligência artificial deixem claro ao eleitor quando determinado conteúdo foi gerado ou editado por ferramentas automatizadas. Plataformas digitais podem ser responsabilizadas caso não removam rapidamente conteúdos falsos durante o período eleitoral.

Mesmo com essas medidas, juristas reconhecem que a velocidade da tecnologia é maior do que a capacidade de regulação.

Pela legislação brasileira, divulgar fatos sabidamente falsos capazes de influenciar o resultado da eleição pode configurar crime eleitoral. Dependendo do caso, os responsáveis podem responder por falsidade ideológica, difamação ou calúnia.

Ainda assim, o principal desafio é identificar rapidamente o conteúdo manipulado antes que ele se espalhe pelas redes.

-

Embora o fenômeno ainda esteja em expansão, o uso de inteligência artificial para manipular conteúdos políticos já foi registrado no país.

Durante as eleições municipais de 2024, circularam vídeos falsos que simulavam reportagens de telejornais e até áudios de candidatos supostamente confessando crimes. Em alguns casos, a tecnologia foi usada para “ressuscitar” figuras políticas já falecidas declarando apoio a determinados candidatos.

Especialistas também alertam para a evolução das chamadas cheap fakes, manipulações mais simples, como cortes de vídeo fora de contexto ou montagens rudimentares, que muitas vezes têm impacto semelhante ao de deepfakes sofisticados.

Para a pesquisadora Nicole De March, que estuda desinformação em redes sociais, essas campanhas costumam ser planejadas com objetivos específicos.

“As mensagens fraudulentas não surgem por acaso. Elas são deliberadamente produzidas para atingir um alvo e causar dano”, afirma a pesquisadora.

À medida que ferramentas de inteligência artificial se tornam mais acessíveis, especialistas acreditam que o número de casos tende a crescer nas próximas disputas eleitorais.

A VULNERABILIDADE DOS ELEITORES IDOSOS

Entre os grupos mais expostos à manipulação digital estão os eleitores idosos. Embora representem uma parcela significativa do eleitorado brasileiro, muitos deles tiveram pouco contato com tecnologia durante grande parte da vida.

Isso os torna particularmente vulneráveis a golpes e desinformação disseminados por aplicativos de mensagens ou redes sociais. Áudios falsos, vídeos manipulados e notícias fabricadas costumam circular em grupos familiares ou comunitários, muitas vezes sem verificação prévia.

Idosos estão mais suscetíveis a fakenews por falta de afinidade com a tecnologia (Foto: Ilustração/Freepik)

Pesquisadores apontam que o fenômeno está diretamente relacionado à chamada “educação midiática”, a capacidade de avaliar criticamente a informação consumida no ambiente digital.

O sociólogo Richard Miskolci, professor da Universidade Federal de São Paulo e pesquisador da área de sociologia digital, afirma que a desinformação se insere em um novo ecossistema informacional dominado por plataformas digitais e aplicativos de mensagens, onde as fronteiras entre informação e propaganda se tornam cada vez mais difusas.

Sem políticas de educação tecnológica e alfabetização digital, especialistas alertam que parte do eleitorado continuará vulnerável à manipulação.

Confira abaixo, um exemplo claro de Deepfake utilizando o rosto do jornalista americano Anderson Cooper:

O DESAFIO DA DEMOCRACIA NA ERA DAS MÁQUINAS

A discussão sobre inteligência artificial nas eleições não envolve apenas tecnologia, mas também democracia.

Para o cientista político Antonio Lavareda, especialista em comportamento eleitoral e marketing político, a comunicação política sempre evoluiu conforme surgiam novos meios, da televisão às redes sociais. Agora, a inteligência artificial inaugura uma nova etapa desse processo.

O desafio, segundo pesquisadores, é garantir que as ferramentas tecnológicas sejam utilizadas de forma transparente e responsável.

Debates recentes no Brasil apontam para três frentes principais de enfrentamento ao problema: regulação das plataformas digitais, fortalecimento do jornalismo profissional e ampliação da educação midiática da população.

Enquanto isso, especialistas concordam em um ponto: nas próximas eleições, a disputa política não ocorrerá apenas nos palanques ou nos programas de televisão, mas também em algoritmos, redes sociais e sistemas de inteligência artificial.

A democracia brasileira, portanto, passa a enfrentar um novo tipo de batalha, que é a luta pela verdade em um ambiente onde a tecnologia pode tornar a mentira cada vez mais convincente.