IA do Instagram alucina e inventa que banda tem ligação com supremacia branca

Plataforma admitiu erro e disse que ele foi corrigido

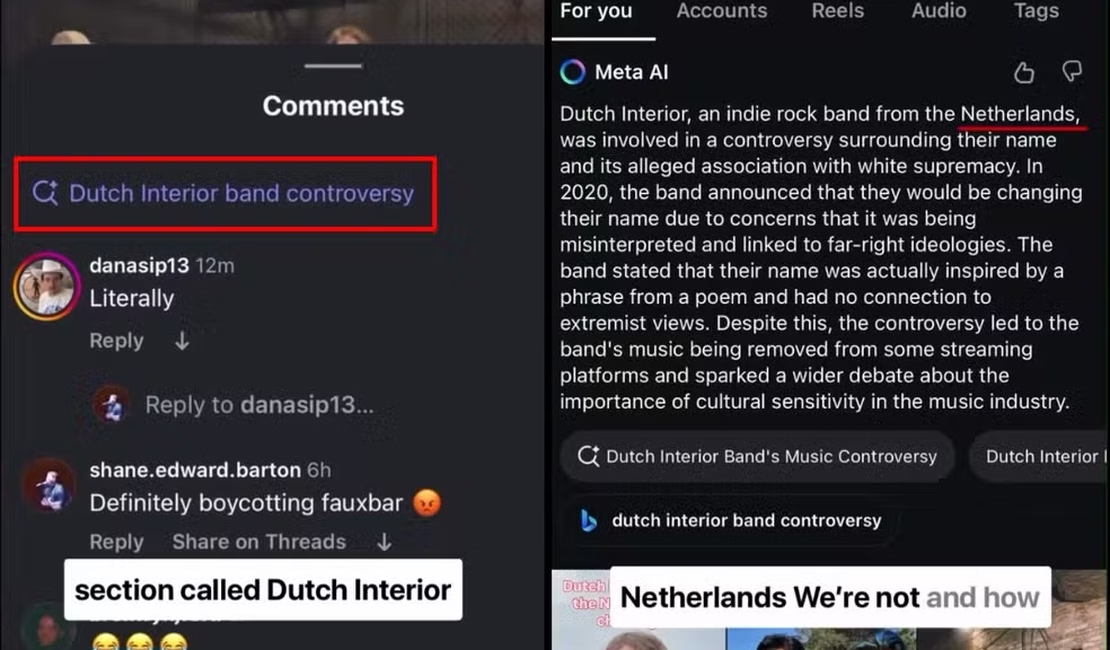

Um recurso do Instagram que usa inteligência artificial para gerar textos associou por engano membros de uma banda a grupos de supremacia branca.

A funcionalidade está dentro do pacote Meta AI, que também deu respostas erradas quando foi lançada no WhatsApp. Ela é parecida com o que já existe no TikTok, que coloca um link em termos que a plataforma considera mais relevante para os usuários.

O erro foi revelado em 3 de julho por um dos integrantes da Dutch Interior, uma banda americana. A Meta, dona do Instagram, admitiu a falha e disse que ela foi corrigida.

Segundo o músico, a acusação falsa apareceu como sugestão de busca na seção de comentários de um vídeo com mais de 90 mil visualizações até quinta-feira (10).

Alguns usuários poderiam ver um atalho para uma página que trataria sobre uma suposta "polêmica do Dutch Interior". O recurso não está disponível no Brasil.

O Instagram afirmou indevidamente, em um texto gerado por IA, que o nome da banda tinha "suposta associação com a supremacia branca".

A rede social disse ainda que serviços de streaming removeram músicas da banda por esse motivo e que o grupo mudaria de nome por medo de ser mal interpretado e ligado pelo público a ideologias de extrema direita.

Mas nada disso aconteceu: a banda continua disponível em serviços de streaming, seu nome não foi alterado e não foi possível encontrar nenhuma menção na internet sobre associação com supremacia branca.

O recurso errou até mesmo a nacionalidade da banda, chamando-a de holandesa – o nome do grupo significa "interior holandês".

"A Meta AI inventou uma polêmica falsa sobre a nossa banda e a promoveu no Instagram para milhares de pessoas", disse o músico que revelou o caso.

"Só queremos saber como isso pode ser permitido. Nosso vídeo teve dezenas de milhares de visualizações, o que significa que milhares de pessoas que nunca tinham ouvido falar de nós podem ter sido expostas a essa desinformação".

Procurada pelo g1, a Meta disse que corrigiu o problema assim que o identificou e pediu desculpas pelo erro.

"Como qualquer sistema de IA generativa, pode não retornar as respostas que pretendemos. Estamos constantemente buscando feedback sobre a Meta AI e nossos modelos para aprimorá-los ao longo do tempo", disse a empresa, em nota.

A Meta não explicou em quais situações ele é exibido e quais as fontes do conteúdo exibido aos usuários.

Veja também

Últimas notícias

Prefeitura de Penedo inicia projeto Cultura Presente na Praça na próxima sexta-feira, 22

Prefeitura de Penedo chega a final nacional do Prêmio Sebrae Prefeitura Empreendedora 2026

Marcelo Beltrão destaca fortalecimento dos municípios durante a XXVII Marcha em Brasília

Trabalho de Rafael Brito garante reajuste automático do piso do magistério para todos os professores

Projeto de Cabo Bebeto aprovado na ALE obriga escolas a comunicar pais sobre atividades de gênero

Semarh divulga previsão do tempo para esta quarta-feira (20) em Alagoas

Vídeos e noticias mais lidas

Publicado edital para o concurso do Detran; veja cargos e salários

Jovem é expulso após ser flagrado se masturbando dentro de academia de Arapiraca

Jovem morre após complicações de dengue hemorrágica em Arapiraca

Com avanço das obras, novo binário de Arapiraca já recebe sinalização e mobiliários urbanos